Während viele Wirtschaftszweige 2025 mit wirtschaftlicher oder regulatorischer Unsicherheit konfrontiert waren, setzte künstliche Intelligenz ihren Aufstieg ungebremst fort. Das Innovations- und Entwicklungstempo blieb außergewöhnlich: Neue Modelle erschienen im Monatsrhythmus, und Unternehmen investierten zweistellige Milliardenbeträge in Chipentwicklung, Cloud-Kapazitäten und digitale Plattformen. Aus einer Softwarebewegung ist in kurzer Zeit ein industrieller Sektor entstanden – mit einer wachsenden Abhängigkeit von physischer Infrastruktur.

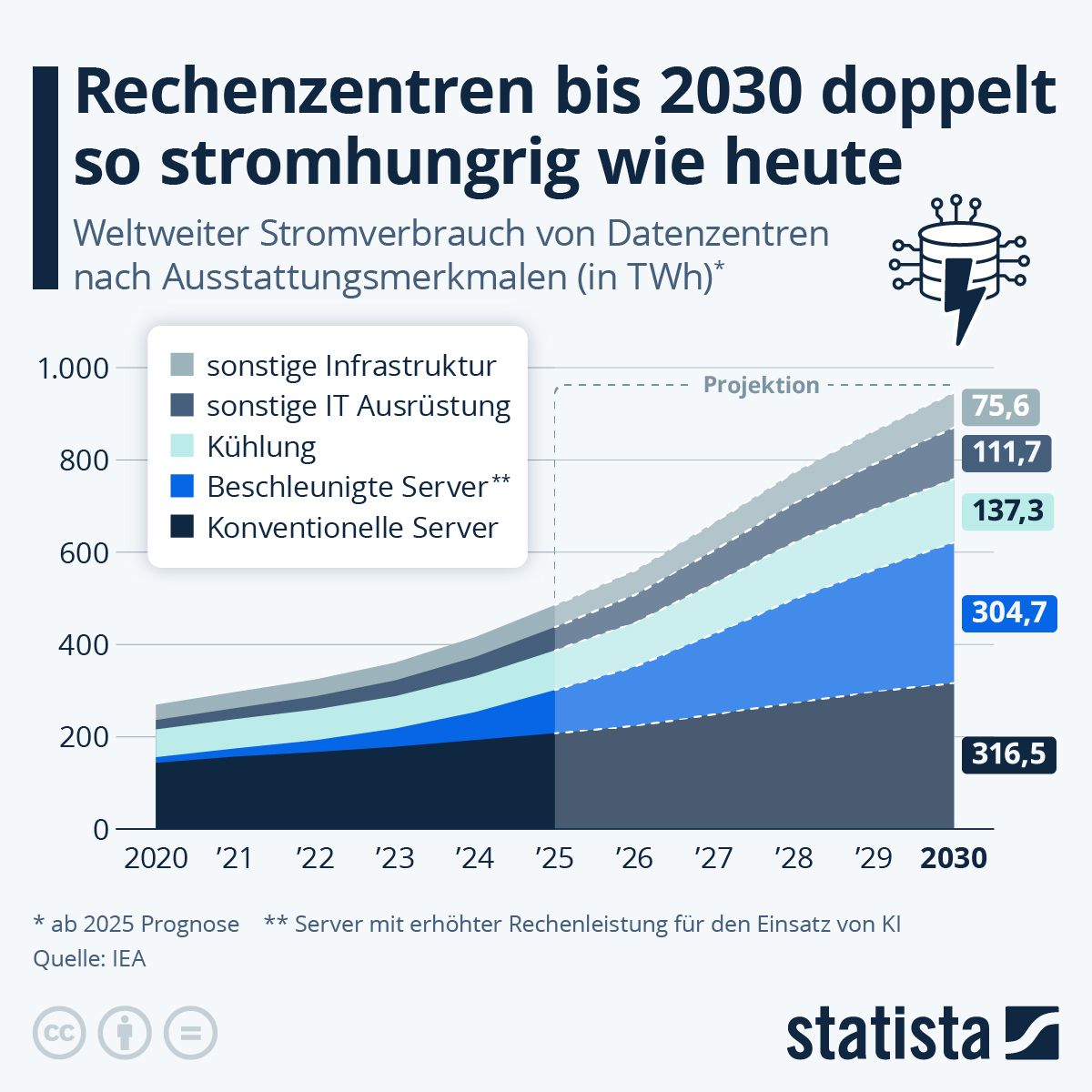

Die Größenordnung dieses Wachstums lässt sich klar beziffern. Der weltweite Stromverbrauch von Rechenzentren lag 2025 bei rund 500 TWh und damit höher als der gesamte Jahresstromverbrauch Deutschlands. Prognosen gehen davon aus, dass Rechenzentren bis 2030 einen Anteil von 3–8 % am globalen Stromverbrauch erreichen könnten – abhängig vom weiteren Ausbau großer Sprachmodelle und der steigenden Last durch Training und Prompting.

Parallel wächst der Ressourcenbedarf für Kühlung, geeignete Standorte und spezialisierte Hardware. Jede Trainingsiteration, jede Modellanfrage und jeder neue Parameterblock benötigen Energie, Wasser und leistungsfähige Rechenressourcen. KI-Systeme existieren nicht im luftleeren Raum – sie hängen an einer kritischen, technisch hochspezialisierten Infrastruktur: dem Rechenzentrum. Rechenzentren bilden das Rückgrat der digitalen Wertschöpfung. In ihnen laufen zentrale Komponenten der KI-Anwendungen: GPUs für Training und Nutzung, Serverracks, Speichersysteme, Netzwerktechnik, redundante Stromversorgung sowie ausgefeilte Kühl- und Sicherheitssysteme.

Dominiert wird dieser Markt von wenigen globalen „Hyperscalern“ – wie Amazon (AWS), Google oder Microsoft. Ergänzt werden sie durch „Colocation-Anbieter“ und spezialisierte Betreiber, die regionale Märkte bedienen.

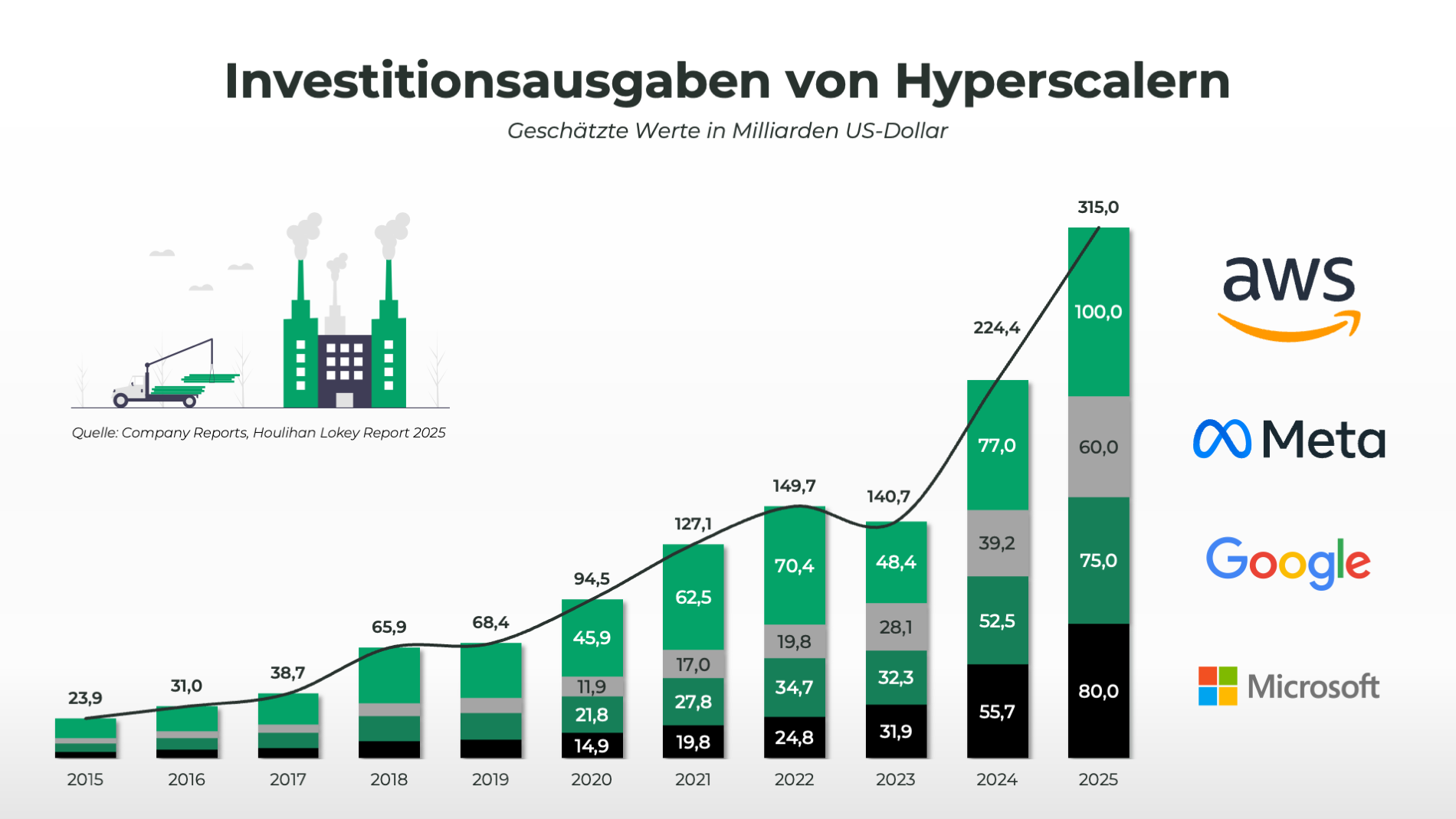

Eine aktuelle Übersicht über die Investitionen der Hyperscaler zeigt die Dynamik dieses Marktes. Unternehmen wie AWS, Google, Microsoft und Meta erhöhten ihre Ausgaben für Infrastruktur zwischen 2015 und 2025 um mehr als das zehnfache und erreichen inzwischen über 300 Milliarden US-Dollar pro Jahr – Tendenz steigend!

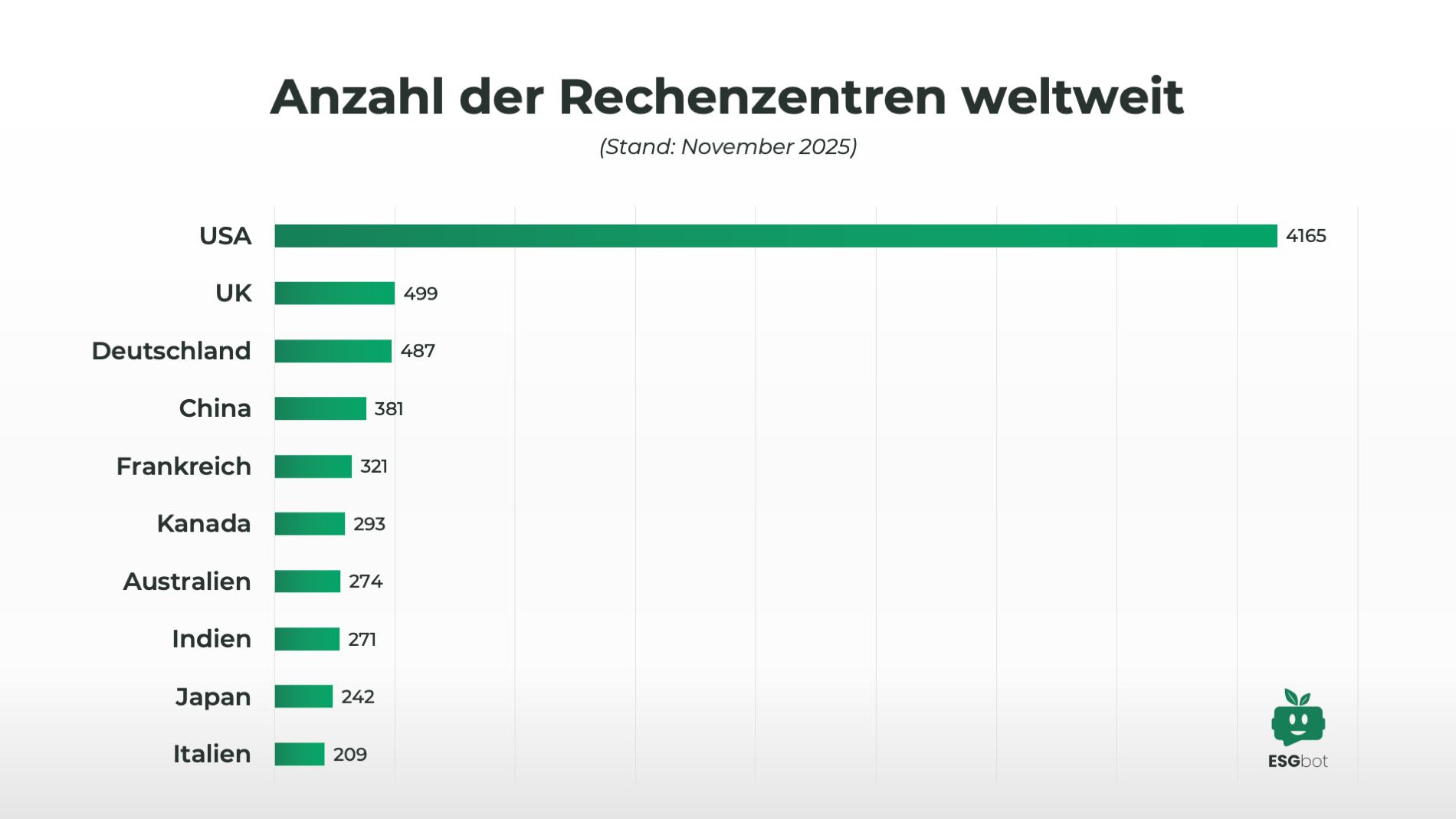

Die weltweite Rechenzentrumslandschaft zeigt eine starke Konzentration auf wenige Länder: Die USA verfügten 2025 über 4.165 Rechenzentren – mehr als achtmal so viele wie Deutschland (487) und deutlich mehr als jedes andere Land. Dahinter folgen das Vereinigte Königreich (499), China (381) und Frankreich (321). Diese Verteilung verdeutlicht die strukturelle Dominanz der USA im globalen KI-Ökosystem und die enge Abhängigkeit Europas von US-basierter Infrastruktur, Cloud-Diensten und technologischem Know-how.

Der Ausbau der Rechenzentrumsinfrastruktur folgt dabei klaren Standortlogiken: Regionen mit niedrigen Strompreisen, hoher Netzstabilität oder politischer Förderung ziehen Investitionen an, während ressourcenknappe Länder zunehmend unter Druck geraten.

Parallel steigt die Relevanz von Rechenzentren als kritische Infrastruktur – etwa im Kontext von IT-Sicherheit, Energieversorgung und staatlicher Resilienz. Auch Europa versucht, durch den Ausbau eigener Kapazitäten und neue regulatorische Initiativen ein Mindestmaß an digitaler Souveränität zu sichern.

Diese Ausgangslage führt zur zentralen Frage dieses Artikels: Wie nachhaltig kann KI sein, wenn ihr Ressourcenbedarf gleichzeitig exponentiell wächst? Um diese Frage fundiert zu beantworten, betrachten wir im nächsten Schritt die Grundlagen und Funktionsweise moderner Rechenzentren – und anschließend die beiden entscheidenden Nachhaltigkeitsfaktoren Energie und Wasser.

Technisch betrachtet bestehen Rechenzentren aus drei zentralen Funktionsbereichen: Rechenleistung, Datenspeicherung und Netzwerkanbindung. Die Recheneinheiten werden zunehmend von speziellen GPUs (Graphic Processing Units) für KI ergänzt, da sie die parallelisierten Berechnungen großer Modelle deutlich schneller ausführen. Ergänzt wird diese Infrastruktur durch Speichersysteme für Trainingsdaten sowie durch komplexe Glasfasernetze im Inneren der Anlage. Rechenzentren sind darauf ausgelegt, aktiv gekühlt und unterbrechungsfrei mit Strom versorgt zu werden. Große Batterien und Notstromaggregate sorgen dafür, dass selbst kurze Ausfälle abgefangen werden. Gleichzeitig verfügen die Anlagen über mehrstufige Sicherheits- und Brandschutzsysteme, da selbst kleine Störungen große Datenverluste verursachen können.

Mit dem Aufstieg Künstlicher Intelligenz verändern sich auch die technischen Anforderungen an Rechenzentren. Untenstehendes Bild zeigt die Serverracks im Innenraum eines Microsoft-Rechenzentrums in Dublin, worauf wir später wieder zurückkommen.

Die Leistungsdichte von Serverracks ist in den vergangenen Jahren stetig gestiegen. Vor gut einem Jahrzehnt lagen typische Rechenlasten noch bei wenigen Kilowatt pro Rack, inzwischen erreichen moderne Anlagen im Durchschnitt bereits Werte im oberen Zehn-Kilowatt-Bereich. Viele Racks überschreiten mittlerweile 20 Kilowatt, und ein wachsender Anteil erreicht sogar mehr als 40 Kilowatt. Mit dem Aufkommen leistungsstarker KI-Systeme verschiebt sich diese Entwicklung weiter. Für das Training großer Sprachmodelle werden Hardware-Cluster benötigt, die pro Rack 60 bis weit über 100 Kilowatt aufnehmen können. Besonders GPU-basierte Systeme von Nvidia treiben diese Entwicklung voran, da sie enorme Rechenleistung auf kleinem Raum bündeln.

Ein Rack ist dabei ein vertikales Gestell, in dem Server, Netzwerktechnik und Stromversorgungsmodule eingebaut werden. Die früher typische Herausforderung war der Platzbedarf – heute ist es die Leistungsdichte. Jede zusätzliche GPU erhöht nicht nur die Rechenleistung, sondern produziert auch erhebliche Mengen Abwärme. Je dichter ein Rack bestückt wird, desto mehr Energie muss zugeführt und desto mehr Wärme muss abgeführt werden. Die Leistungsdichte wächst damit schneller als die benötigte Fläche. Aus diesem Grund müssen viele Betreiber ihre elektrischen und thermischen Systeme vollständig neu auslegen.

Um die Verfügbarkeit solcher Anlagen zu bewerten, nutzt die Branche die Tier-Klassifizierung des Uptime Institute. Sie reicht von Tier I (einfacher Aufbau) bis Tier IV (vollständige Redundanz). Für KI-Cluster mit hohen Trainingskosten kommen in der Regel Tier-III- oder Tier-IV-Infrastrukturen infrage. Dort ist gewährleistet, dass zentrale Komponenten während des laufenden Betriebs ausgetauscht werden können und dass die wichtigsten Systeme mehrfach vorhanden sind. Für KI spielen vor allem die großen Hyperscaler eine dominierende Rolle, da sie die leistungsfähigsten GPU-Cluster bereitstellen und über globale Netzwerke verfügen, die Milliarden von Anfragen täglich verteilen.

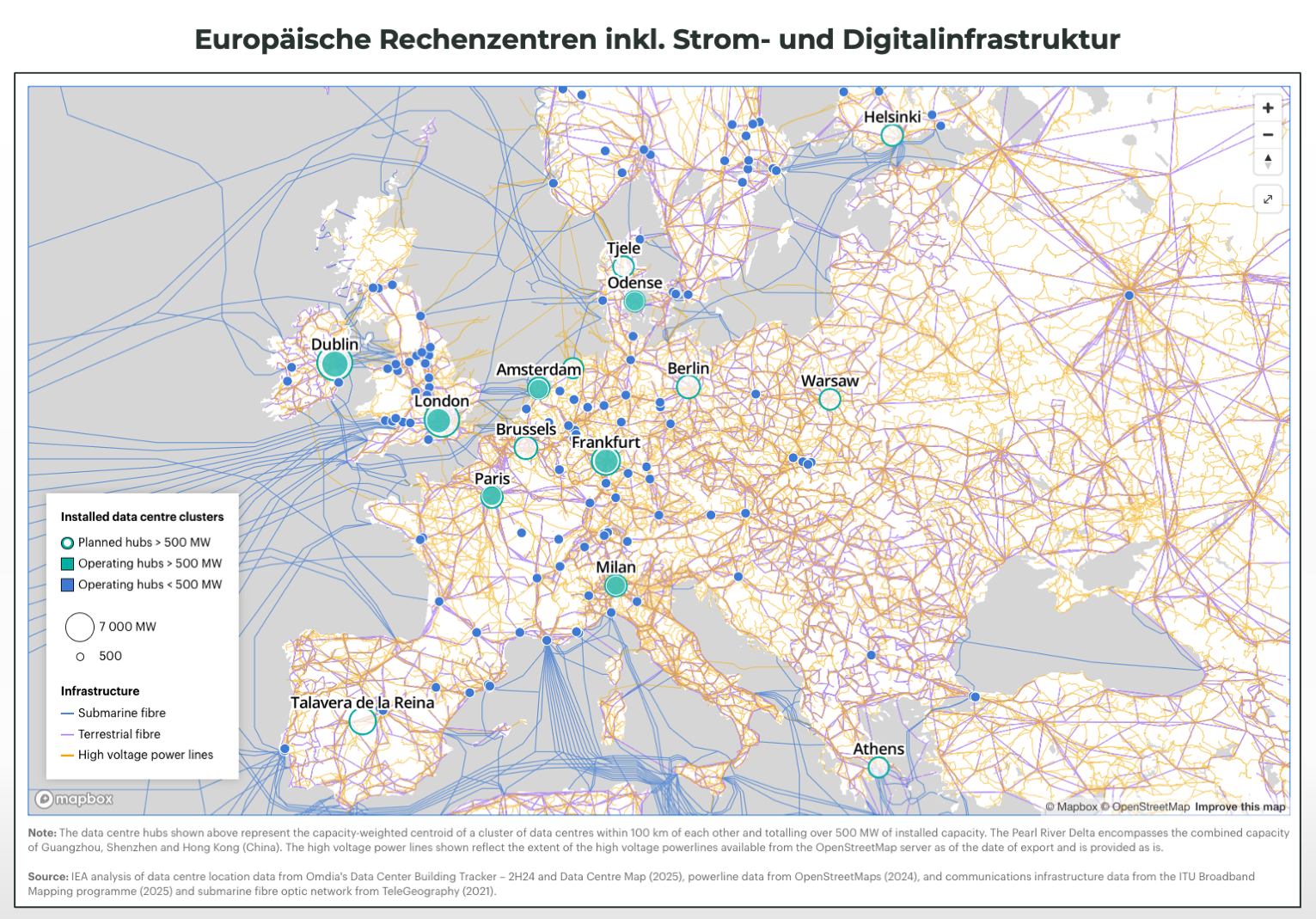

Zahlreiche dieser Investitionen befinden sich auch in Europa. Frankfurt, London, Amsterdam, Paris und Dublin bilden seit Jahren die wichtigsten Knotenpunkte für Rechenleistung und Konnektivität. Diese Städte vereinen ideale Standortbedingungen: leistungsstarke Strom- und Glasfasernetze, eine hohe Dichte an Cloud- und Interconnection-Anbietern sowie historisch gewachsene digitale Ökosysteme. Doch ihr Erfolg bringt strukturelle Grenzen mit sich. Stromnetze stoßen vielerorts an Belastungsgrenzen, Flächen werden knapp und Genehmigungsverfahren dauern zunehmend länger.

Die Abbildung zeigt die räumliche Verteilung der europäischen Rechenzentren und ihre Verbindung zu Strom- und Glasfasernetzen. Besonders auffällig ist die Konzentration leistungsfähiger Stromtrassen in Nord- und Westeuropa sowie die Clusterbildung rund um Küstenregionen, große Ballungsräume und Länder mit hoher Netzstabilität. Die Karte macht sichtbar, warum Infrastrukturengpässe zu regionalen Wachstumshemmnissen werden – und warum manche Regionen erheblich an Bedeutung gewinnen.

Die Standortwahl verschiebt sich dadurch. Energieverfügbarkeit, Netzkapazitäten und regulatorische Bedingungen sind heute entscheidender als die reine Nachfrage. Skandinavische Länder profitieren durch niedrige Temperaturen und einen hohen Anteil erneuerbarer Energien. Spanien und Portugal entwickeln sich aufgrund ihrer starken Solar- und Windkraftpotenziale zu attraktiven Zielregionen. Deutschland, Irland und die Niederlande müssen dagegen mit Netzengpässen, höheren Strompreisen oder zeitweisen Genehmigungsstopps umgehen.

Irland nimmt hier eine besondere Rolle ein. Das Land erlebte in den vergangenen Jahren wiederholt Stromengpässe, weil das nationale Stromnetz an seine Belastungsgrenzen stieß. Ursache ist eine Kombination aus begrenzter eigener Erzeugungskapazität und einem außergewöhnlich hohen Zubau an Rechenzentren. Viele große Tech-Konzerne – darunter Meta, Google, Microsoft und Amazon – haben ihre europäischen Hauptquartiere in Irland angesiedelt, meist aus steuerlichen Gründen. Dieser steuergetriebene Standortvorteil führte zu einer überproportionalen Konzentration digitaler Infrastruktur, deren Energiebedarf das Netz heute kaum noch aufnehmen kann.

Jede Antwort, die ein großes Sprachmodell generiert, und jeder Trainingsschritt, der ein Modell leistungsfähiger macht, benötigt elektrische Energie. Schätzungen der Internationalen Energieagentur zufolge verbrauchten Rechenzentren im Jahr 2025 bereits rund 500 Terawattstunden Strom. Bis 2030 dürfte sich dieser Wert nahezu verdoppeln, vor allem getrieben durch Hochleistungsserver für KI und den damit verbundenen Kühlbedarf.

Die IEA-Projektion zeigt deutlich, dass beschleunigte Server – also GPU-basierte Systeme für KI – den stärksten Wachstumsbeitrag leisten. Zugleich wird sichtbar, dass auch konventionelle Server, Kühlung und sonstige Infrastruktur weiterhin erhebliche Strommengen benötigen. Es ist daher nicht nur „die KI“, die Energie verbraucht, sondern das gesamte Ökosystem aus digitaler Infrastruktur.

Der Energiebedarf von KI entsteht an zwei Stellen: beim Training und bei der späteren Anwendung des Modells. Das Training großer Modelle ist besonders rechenintensiv, da Milliarden von Parametern über viele Trainingszyklen hinweg angepasst werden müssen.

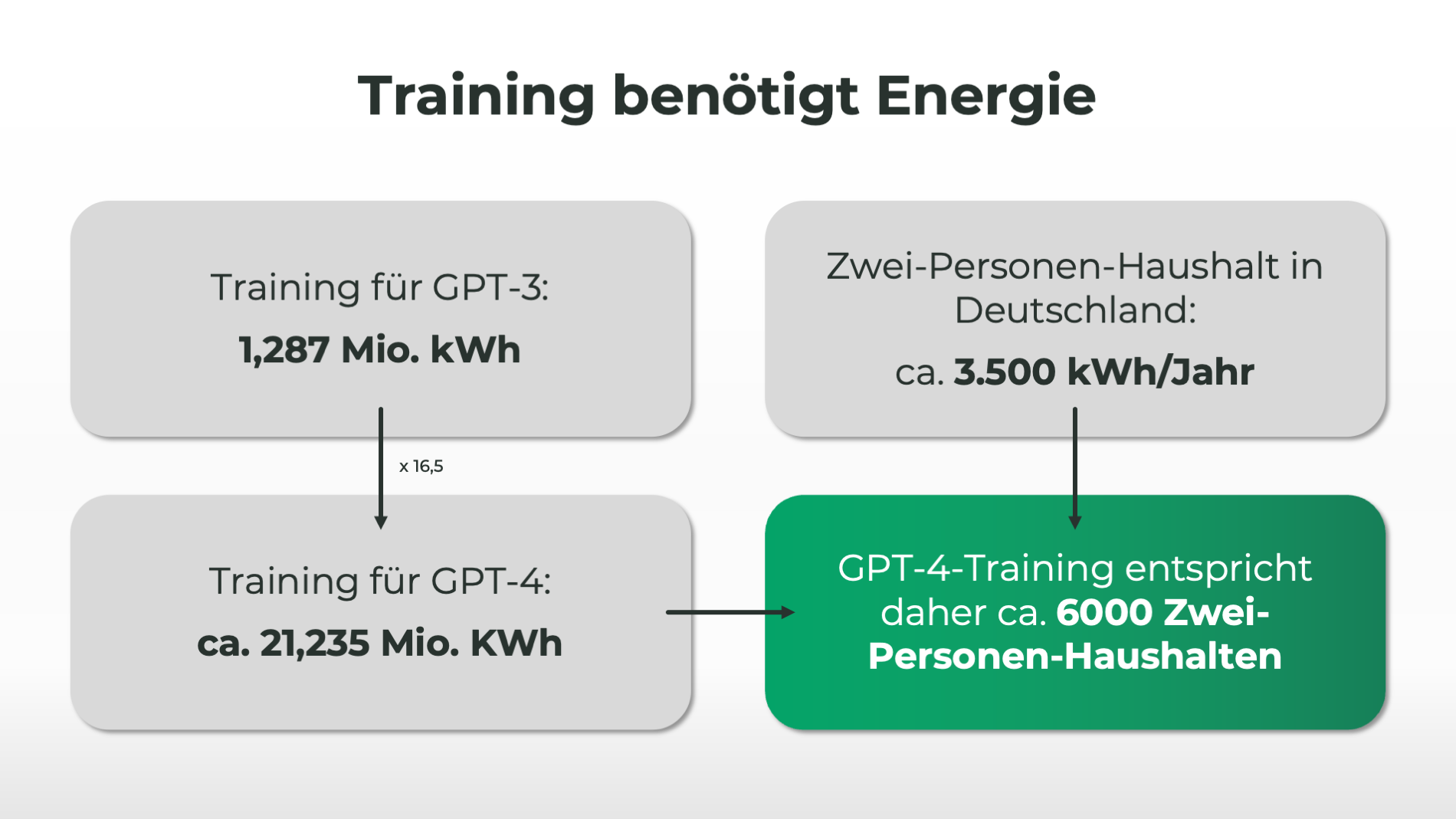

Für GPT-3 wird der Energiebedarf auf rund 1,29 Millionen Kilowattstunden geschätzt. Für GPT-4 liegt er laut verfügbaren Berechnungen etwa beim 16,5-Fachen davon – also bei mehr als 21 Millionen Kilowattstunden. Dieser Energieaufwand entspricht grob dem Jahresverbrauch von rund 6.000 durchschnittlichen Zwei-Personen-Haushalten in Deutschland.

Die Nutzung ist im Vergleich zum Training wesentlich sparsamer, findet dafür aber millionenfach häufiger statt. Eine einzelne Anfrage an ChatGPT erfordert Schätzungen zufolge etwa 2,9 Wattstunden Strom – rund zehnmal so viel wie eine Standard Google-Suchanfrage. Während eine Suchmaschine Informationen aus einem bestehenden Index abruft, müssen Sprachmodelle bei jeder Anfrage Millionen von Parametern verarbeiten. Diese Entwicklung hat unmittelbare Folgen für Energiesysteme und Strommärkte. Meta Platforms plant im US-Bundesstaat Louisiana den Bau eines der größten KI-Rechenzentren weltweit (siehe Bild) mit einer elektrischen Leistungsaufnahme von etwa zwei Gigawatt.

Für die dafür erforderliche Energie soll die lokale Infrastruktur massiv ausgebaut werden, unter anderem durch drei neue Gaskraftwerke. Die Baukosten von rund fünf Milliarden Dollar sollen jedoch nicht vollständig vom Unternehmen getragen werden, sondern über Umlagen des regionalen Energieversorgers auf die etwa 1,1 Millionen Kunden verteilt werden. Kritiker warnen vor erheblichen wirtschaftlichen Belastungen der Bevölkerung.

Um den wachsenden Energiebedarf langfristig abzusichern, prüfen Meta, Google und Amazon den Bau kleiner modularer Kernkraftwerke. Dieser Ansatz ist umstritten, zeigt aber die Dimension des erwarteten Wachstums. Project Suncatcher hingegen ist ein langfristiges Forschungsprojekt von Google, das untersucht, wie künstliche Intelligenz künftig außerhalb der Erde betrieben werden kann – mithilfe von satellitengestützten Datenzentren, die im All unterwegs sind. Was erstmal wie SciFi klingt, könnte ein großer Teil der Lösung sein. Die Vision sieht vor, kleine, gut ausgestattete Satelliten in einer sonnensynchronen Erdumlaufbahn zu betreiben, um die Energieknappheit und Kühlungsproblematik zu umgehen und damit das Potenzial zu schaffen, KI-Workloads mit äußerst hoher Energiedichte nachhaltig zu betreiben. Für Strom und Kühlung wäre hier aufgrund der äußeren Begebenheiten automatisch gesorgt.

Der ökologische Fußabdruck von KI hängt somit stark von der Herkunft der eingesetzten Energie ab. Wird Strom aus fossilen Quellen genutzt, steigen die Emissionen entsprechend. Rechenzentren, die dagegen auf Grünstrom oder PV-Strom verursachen deutlich geringere Umweltauswirkungen. Ein weiterer Hebel ist die Nutzung der Abwärme, die bei der Kühlung entsteht. In Schweden und Dänemark speisen Rechenzentren seit Jahren überschüssige Wärme in lokale Fernwärmenetze ein. Ein besonders großes Projekt existiert in Odense (Dänemark), wo die Abwärme eines Rechenzentrums anfangs jährlich über 100.000 Megawattstunden – nach Erweiterung 165.000 MW – bereitstellt. Dadurch können mehrere tausend Haushalte versorgt werden. In Deutschland wurde ein solches Modell bereits in Norderstedt umgesetzt, wo Rechenzentrumsabwärme in ein kommunales Wärmenetz integriert wurde.

KI kann jedoch nicht nur Energie verbrauchen, sondern auch helfen, sie effizienter zu nutzen. Google setzt seit mehreren Jahren künstliche Intelligenz ein, um den Energieverbrauch seiner Rechenzentren zu optimieren, insbesondere im Bereich der Kühlung. Bereits 2016 berichtete Google, dass sie mithilfe von KI den Energiebedarf für die Kühlung in eigenen Rechenzentren um rund 40 % reduzieren konnten.

Kühlung ist neben Strom die zweite entscheidende physische Voraussetzung für den Betrieb moderner Rechenzentren. Jede GPU, jeder Serverchip und jeder Netzwerkswitch erzeugt Wärme, die kontinuierlich abgeführt werden muss, damit die Anlage stabil bleibt. Wie Rechenzentren kühlen, ist jedoch sehr unterschiedlich – und genau diese Unterschiede bestimmen, wie viel Wasser sie verbrauchen.

Grundsätzlich gibt es zwei Kühlprinzipien: strombasierte Kühlung und wasserbasierte Kühlung. Bei der strombasierten Kühlung wird die Abwärme über Luftströme abgeführt. Große Lüfter und Kompressionskältemaschinen transportieren die Wärme aus dem Serverraum und halten die Betriebstemperaturen stabil. Dieses Verfahren benötigt viel Strom, aber vergleichsweise wenig direktes Wasser. Die wasserbasierte Kühlung setzt dagegen auf Verdunstungskälte oder indirekte Kühlung über geschlossene Wasserkreisläufe. Bei der Verdunstung wird Wasser gezielt verdampft, sodass es Wärme aufnimmt und das System abkühlt. Bei der indirekten Kühlung durch Wasserkreisläufe wird Wasser im System bewegt und wieder abgekühlt, ohne dass es verloren geht.

In modernen Rechenzentren kommen häufig Hybridsysteme zum Einsatz, die strom- und wasserbasierte Verfahren kombinieren. Bei geringen Außentemperaturen arbeiten Anlagen mit „freier Kühlung“ nahezu ohne zusätzlichen Energieaufwand. Sobald die thermische Last steigt, schalten sie auf um. Der Wasserbedarf steigt damit nicht linear, sondern sprunghaft, sobald Außentemperaturen und Serverlast hoch genug sind.

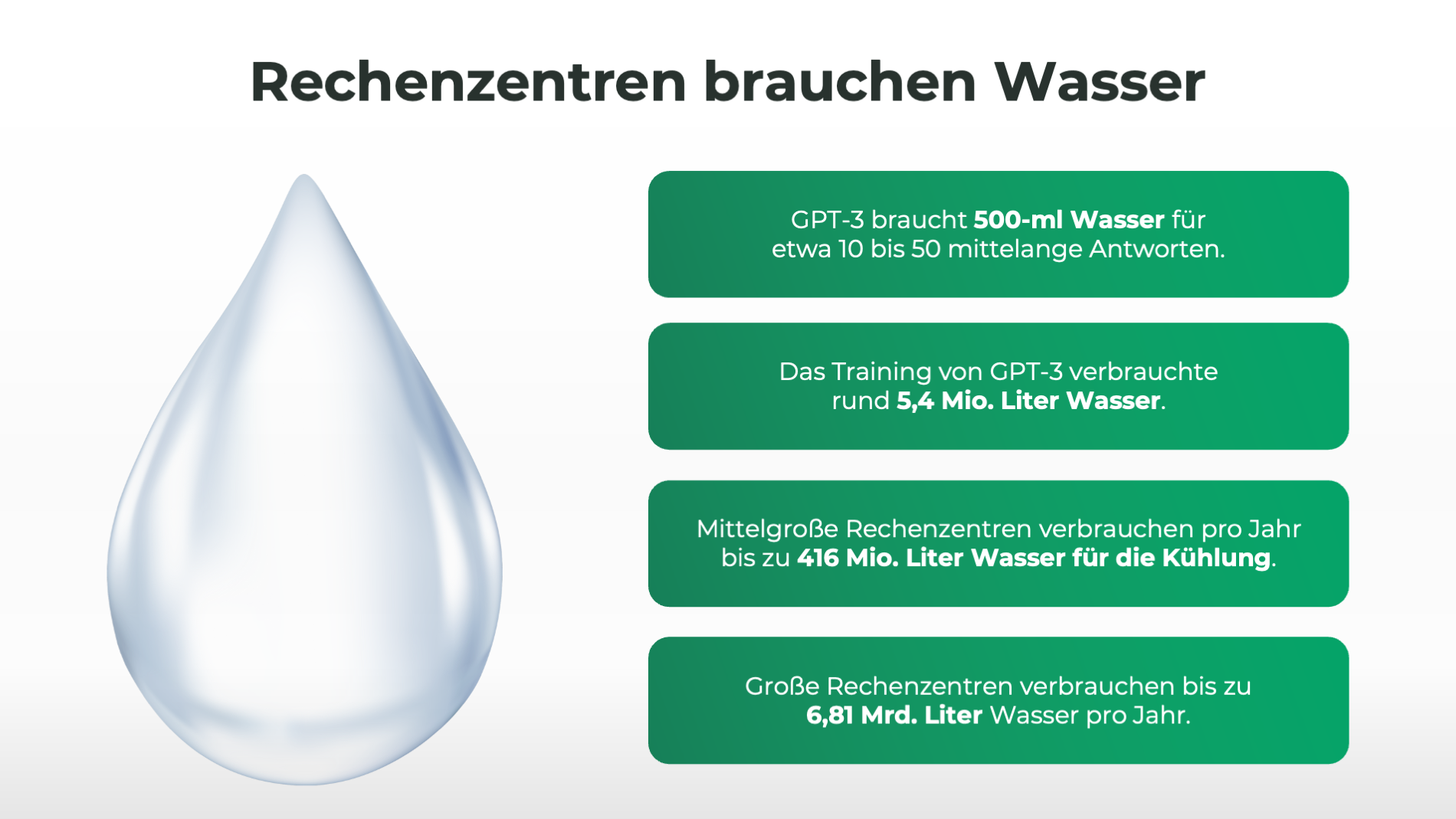

Wie groß dieser Verbrauch sein kann, zeigen aktuelle Daten sehr deutlich. Mittelgroße Rechenzentren verbrauchen bis zu 416 Millionen Liter Wasser pro Jahr, große Zentren bis zu 6,81 Milliarden Liter. Eine Studie aus den USA hebt hervor, dass der Wasserverbrauch eines Rechenzentrums stark vom Standort abhängt: In sonnenreichen Staaten wie Arizona kann die Kühlung pro Kilowattstunde IT-Last um ein Vielfaches höher sein als in nördlichen Regionen. Wasserverbrauch und Energieeffizienz stehen damit oft in einem Zielkonflikt. Je effizienter die Kühlung sein soll, desto höher ist in warmen und trockenen Klimazonen der Wasserverbrauch.

Wie wasserintensiv KI wirklich sein kann, zeigt die Forschung von Long, Cai und Dong (2023). Sie berechnen, dass das Training von GPT-3 etwa 5,4 Millionen Liter Wasser benötigte. Dabei wird nicht nur das Wasser betrachtet, das unmittelbar zur Kühlung eingesetzt wird, sondern auch das Wasser, das bei der Stromerzeugung für die Rechenleistung notwendig war. Für die spätere Anwendung des Modells schätzen sie, dass GPT-3 etwa 500 Milliliter Wasser für 10 bis 50 mittellange Antworten benötigt – ein Wert, der verdeutlicht, dass auch scheinbar kleine Anfragen erhebliche Ressourcen binden, wenn sie millionenfach täglich stattfinden. Diese Wasserbedarfe stehen in direkter Konkurrenz zu kommunalen Ressourcen.

In Irland gibt es regelmäßige Debatten über den Wasserverbrauch, da Irlands Infrastruktur den steigenden Bedarf – wie beim Strom – kaum decken kann. Betreiber mussten in der Vergangenheit Genehmigungsauflagen verschärfen und zusätzliche Wasserspeicher errichten, um Engpässe zu vermeiden. Solche Konflikte zeigen, wie eng die Energie-, Wasser- und Standortfragen miteinander verknüpft sind.

Auch in Deutschland wird Wasser zunehmend zu einem kritischen Faktor. Viele Regionen melden bereits Grundwasserstress – ein Indikator dafür, dass mehr Wasser entnommen als nachgebildet wird. Der fortschreitende Ausbau wasserintensiver Rechenzentren könnte diesen Druck weiter erhöhen, wenn keine klaren Vorgaben für Wassermanagement und Kühltechnologien etabliert werden. In wasserarmen Regionen werden wasserbasierte Systeme daher zunehmend kritisch gesehen, da jeder Liter, der in Rechenzentren eingesetzt wird, an anderer Stelle fehlt.

Gleichzeitig entstehen neue technische Ansätze, um Wasserverbrauch zu reduzieren oder von Süßwasser unabhängiger zu werden. In China wurde das erste Unterwasser-Rechenzentrum in Betrieb genommen, das Meerwasser direkt zur Kühlung nutzt. Allerdings stellt sich die Frage, wie vorteilhaft es langfristig ist, wenn große Mengen Abwärme in die Ozeane abgegeben werden. Auch der Weltraum rückt als Vision ins Blickfeld: Googles „Project Suncatcher“ untersucht – wie zuvor erläutert –, ob KI-Workloads künftig in satellitengestützten Infrastrukturen betrieben werden können, mit nahezu ununterbrochener Solarenergie und ohne die Abhängigkeit von Süßwasser und Kühlung.

Mit jeder neuen Modellgeneration steigen Rechenlast, Kühlaufwand und damit auch die Belastung für Stromnetze und Wasserressourcen. Zwar entwickeln Unternehmen effizientere Hardware und intelligente Steuerungssysteme, doch diese Fortschritte dämpfen das Wachstum bislang nur begrenzt. Somit wächst auch der Druck auf Regionen, die ohnehin mit Wasserstress oder überlasteten Netzen kämpfen. Die entscheidende Frage lautet daher, wie Gesellschaften mit diesen Belastungen umgehen und wie das Zusammenspiel aus Energieinfrastruktur, Kühltechnologien und regional verfügbaren Ressourcen aussehen kann.